引領 AI 治理與確信:取得ISO/IEC 42001 AI 管理系統驗證的理由

本白皮書概述您的組織是否需要以及如何開發、管理並持續符合內部和外部要求,以推進人工智慧在流程、產品和服務中的成功實作。

人工智慧 (AI) 正在改變世界,並為企業和整個社會創造新的機會和挑戰。隨著生成式 AI ChatGPT 和 Copilot 的出現,AI 在企業中的實驗和首次使用呈爆炸式增長。成功的實施案例顯示,人工智慧可以提升效率、品質、創新和客戶滿意度。然而,每一項新技術都有其風險。AI 充滿了潛在的挑戰和不確定性,必須加以管理和緩解,才能安全、可靠且合乎道德地開發、應用和使用。

在此,以 ISO/IEC 42001 標準為基礎的人工智慧管理系統 (AIMS) 對組織管理其人工智慧之旅而言,扮演著不可或缺的角色。結構化的方法可迫使您「思而行」,並持續評估績效與成果。這個關於 AI 管理、風險管理方法和第三方驗證的基礎標準已被公認為引導開發和提供可信賴 AI 解決方案的關鍵所在。

安全、負責任地使用人工智慧的必要性

隨著各行各業對人工智慧應用程式的實驗和採用的增長,利害相關者不斷提高的意識和期望,加上不斷發展的道德和監管環境,人們對可靠人工智慧的需求也日益凸顯。因此,除非彌補 AI 開發者與使用者之間的信任缺口,否則組織無法實現 AI 的效益。信任鴻溝是指對組織的 AI 化產品和/或服務可能缺乏信心和透明度。舉例來說,如果使用者不清楚 AI 系統如何做出決策,就會在安全性、道德考量、資料隱私保護和整體可信度方面產生不確定性和懷疑。簡單來說,我們對技術的信任取決於我們是否能夠完全瞭解其用途,並確保它是安全可靠的。

要將人工智慧產品和服務商業化和規模化,縮小信任差距是不可或缺的。這需要您確保以安全、負責、可靠且合乎道德的方式實作人工智慧。 此外,還必須同時向內部利害相關者,例如您的員工和資深管理階層,以及外部利害相關者,例如客戶和股東提供保證。

要達成並展示解決方案的可信度,需要一套涵蓋整個 AI 生命週期的系統方法,從利害相關者分析、適當的防護欄(例如道德準則)、使用個案優先順序、風險鑑別,一直到相關控制的實施。當我們放大信任差距,就能找出明確的需求與期望,例如,您的組織應該︰

- 鑑別並優先考慮人工智慧可以增加價值和創造影響的領域和應用,並瞭解其效益和風險

- 在組織內部建立並維持信任、透明、當責的文化

- 評估與衡量人工智慧系統的效能與品質,並確保符合可信賴原則、既有或即將實施的法規及客戶需求

- 安排分配組織中的角色與職責,這在持續演進與發展的技術領域中尤其重要

- 針對 AI 開發、實施與管理,採用並實施以最佳實務標準 (例如 ISO/IEC 42001) 為基礎的流程

- 將人工智慧系統的可信度傳達給利害相關者,提供符合最佳實務、法律與法規的證據與確信

儘管並非詳盡無遺,但這是核心需求和期望的概要。人工智慧管理系統標準 ISO/IEC 42001 旨在提供指導和結構,以有效掌握這些需求和期望。

標準化在管理人工智慧方面的作用

每項新技術都有其風險。人工智慧瞬息萬變的面貌,加上其在各產業應用的巨大潛力,更加助長了這種風險,例如,在設計階段預測所有結果是不可能的。

在此背景下,ISO/IEC 42001 等管理系統標準就顯得格外重要。每當需要公眾信任時,標準化和驗證就會發揮舉足輕重的作用。除了法律、法規與倫理考量之外,標準化也提供了一個工具,以實現可擴充性、嵌入安全性,並引導組織進入目前人工智慧的未知領域。

標準建立基本術語、推廣行業導向的規範,並擷取最佳實務以進行評估與改善。以 AI 管理為目標的標準帶來清晰度與責任感,將大大提高社會的接受度。這些標準為法規遵循與行業採用奠定基礎,並加速以安全、負責任與合乎道德的方式發揮人工智慧的全球潛力,確保使用者與其他利害相關者之間所需的透明度、信任度與安全性。

人工智慧管理系統的作用

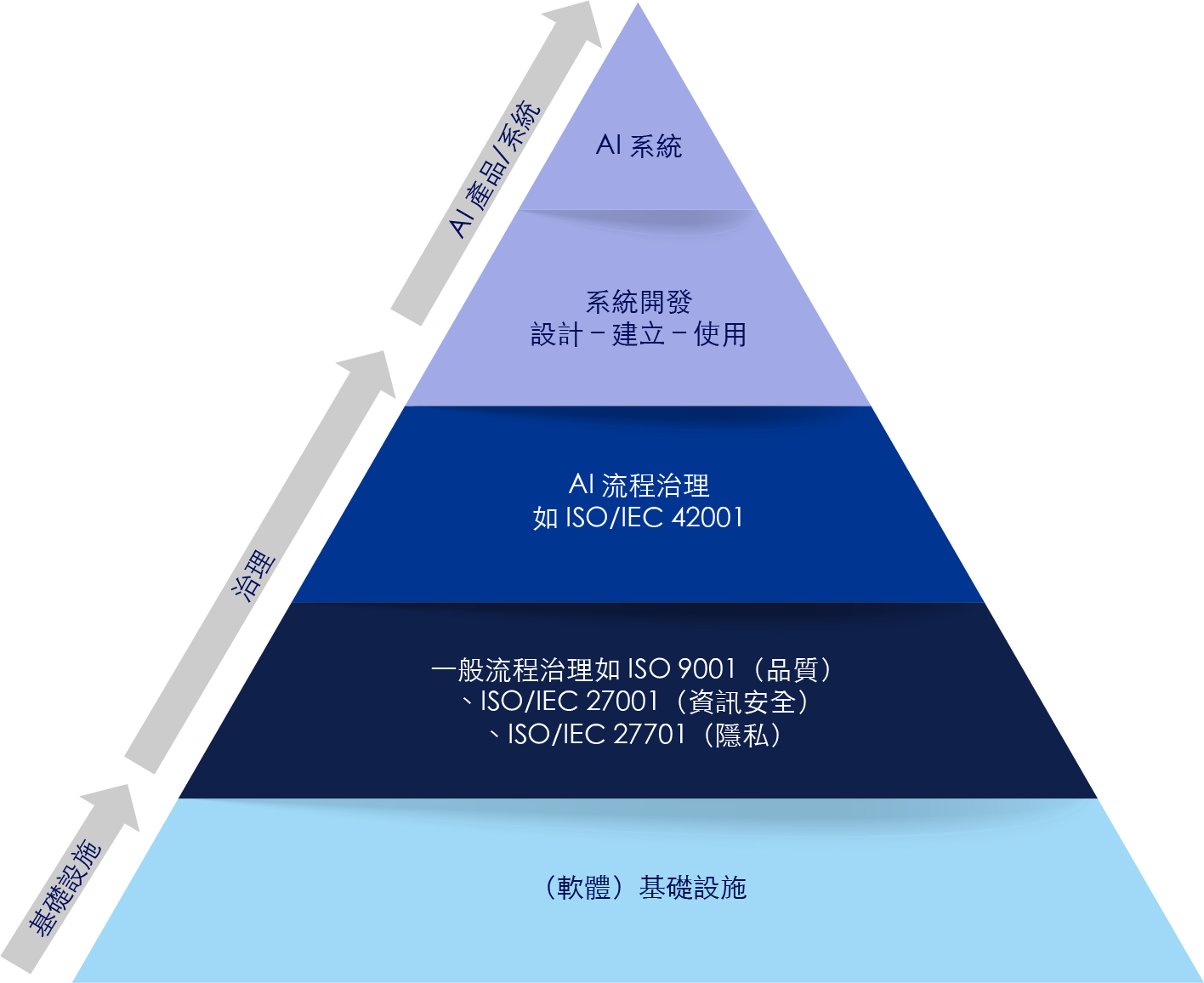

管理系統標準與驗證可作為組織們圍繞 AI 進行治理的穩固基礎(參閱圖 1)。AI 管理系統的國際標準 ISO/IEC 42001 為開發、部署或使用 AI 系統的組織提供指引與要求。

這項備受期待的標準於 2023 年底發表,適用於各行各業,以及參與開發、提供或使用利用 AI 系統的產品和/或服務的任何類型和規模的組織。身為 ISO 標準,它與其他經典的 ISO 管理系統標準(如 ISO 9001(品質)和 ISO/IEC 27001(資訊安全))相容且互補。ISO/IEC 42001 在促進 AI 創新與實施有效管理之間取得平衡。

這意味著您可以利用任何現有的管理系統和一般流程治理,並以此為基礎。它確保以全面的方法來管理如何使人工智慧成為產品、服務甚至內部應用的組成部分。

在下面的示意圖中,我們將 ISO/IEC 42001 定位為「確信金字塔」中的流程治理工具。在金字塔的基礎上,您可以找到組織的基本架構,組織運作所需的一切。為了治理和改善,許多組織選擇實施符合品質 (ISO 9001)、資訊安全 (ISO/IEC 27001) 或任何其他管理系統標準的管理系統。驗證則是向各利害相關者證明符合性的方法。

由於 ISO/IEC 42001 的結構與其他 ISO 管理系統標準相似,因此可讓您的管理系統與 AI 管理系統要求相輔相成。如此一來,您的流程治理就成為設計、建立和使用可信賴 AI 系統的基礎。

ISO/IEC 42001 的主要目標是︰

- 透過採用基於風險的方法,為組織提供涵蓋人工智慧的整個生命週期的框架和方法,來建立、實施、維護和改善人工智慧管理系統

- 使組織的 AI 系統和流程的可信度得以展示和溝通

- 隨著國家/地區和國際法規不斷增加,符合規定將變得越來越重要,本標準要幫助助組織遵守法規和法律,例如已於 2024 年 8 月生效的歐盟人工智慧法案 (EU AI Act)

- 促進人工智慧系統與流程的互通性與整合性

- 促進利害相關者之間的合作與協調

- 支持人工智慧系統和流程的創新與改進

- 鼓勵採用和傳播有關人工智慧管理的最佳實務和標準

ISO/IEC 42001 與人工智慧法律法規之間的關係可望發揮綜效,互惠互利。雖然歐盟人工智慧法案有明顯的產品重點,但採用人工智慧管理系統可為建立和提供一致且可預測的可信賴人工智慧系統提供基礎,而標準的控制也符合法規要求遵守的事項。

最終,一個符合所有相關標準且執行良好的管理系統,將可確保資料使用的完整性、隱私性和道德性,同時具備足夠的適應性,以整合因客戶、技術進步、法律和法規實例等而不斷變化的需求。

展開驗證之旅

如您準備開始採用 ISO/IEC 42001 驗證的管理系統,您可以參考 DNV 這篇「取得 ISO/IEC 42001 驗證的八個步驟」的文章,以及隨附的自我評估工具作為指引。流程始於高階管理階層審查,以確定採用人工智慧管理系統 (AIMS) 的主要原因。在此之後,組織應取得 ISO/IEC 42001 標準,並制定符合已確認目標的策略方向。

接下來的步驟包括規劃和資源分配、瞭解和規劃關鍵流程,以及鑑別員工的訓練需求。準備、開發和實施適用的流程和程序是典型的步驟,在過程中應用內部稽核和管理審查檢查系統的有效性是很重要的。使用 DNV 的自我評估工具將有助於找出與標準要求之間的差距,並採取有針對性的方法來滿足 ISO/IEC 42001 的要求。

為什麼選擇 DNV 為合作夥伴?

身為全球領先的驗證機構,DNV 是全球 80,000 家公司在管理系統驗證與訓練需求上所選擇的合作夥伴。我們在人工智慧和其他管理系統方面擁有獨特的能力、行業知識和實力。選擇 DNV,您將獲得︰

- 全球資訊安全與隱私權保護的領導者: 我們在資訊安全和隱私權驗證與訓練方面擁有良好的紀錄,這對於整合到您的人工智慧管理非常重要

- Risk Based Certification™(基於風險的驗證): 我們採用以風險為基礎的主動式驗證方法,這意味著我們可以協助組織及早鑑別其 AI 系統中的潛在風險,以確保這些風險在成為問題之前就能獲得解決

- Lumina™: 這是我們的資料智慧型標竿管理工具,可深入洞察和分析管理系統,從最常見的故障和修復,到所有公司網站的完整概觀,以及與同行的比較

- 訓練管理: 數位化解決方案可協助您的公司管理並確保全公司員工一致的認知與能力發展

- 稱職的稽核人員以實事求是的態度聆聽客戶的需求,同時注意評估是否符合標準

- 完善的客戶管理流程,提供卓越的客戶體驗

DNV 致力於提供可靠且加值的 AI 確信服務。憑藉我們的獨立性、第三方的角色以及對品質和誠信不妥協的原則,我們與客戶合作,協助他們有信心地因應人工智慧的複雜性和相關挑戰,並確保必要的治理,以提供安全、可靠和有保障的 AI 系統。